Eliezer Yudkowsky

Chaque échelon sur l'echelle de l'IA nous fait gagner plus d'argent...mais un des échelon va détruire le monde.

Yoshua Bengio

IA : "avoir le courage de dire ce que les gens ne veulent pas nécessairement entendre"

Paul Jorion, anthropologue

La fin du travail humain (2014)

Geoffrey Hinton (Père de l'IA, prix Nobel de physique 2024)

"l'IA crée un terrain fertile pour le fascisme"

Emad Mostaque (Stable Diffusion - Stability AI)

"l'IA commencera par remplacer les emplois en col blanc dans un an"

Elon Musk (Londres 2023)

"il arrivera un moment, où nous n'aurons plus besoin d'aucun job"

Ilya Sutskever (ChatGPT):

"dans 3 ans l'IA pourra faire

tout ce que nous faisons"

Harison Ford

"if we don't get off our ass NOW, we are going to lose this place..." (Cannes 2023)

"Generalized rage",

Noam Chomsky (2016)

"La transition énergétique est un slogan",

JB Fressoz (2025)

Munich Social et écologique

Démonstration par S. Brizé, dans son film "En Guerre"

Cedric Villani (Paris 2023)

"La raison première

de notre impuissance (...)"

"le capitalisme est un vrai problème",

Jean Jouzel (sept 2023)-

A "ressource based global economy",

Jacque Fresco..(2012) -

Décroître, ou se voir imposer les pénuries

JM Jancovici (2023)

Gaspillages d'énergies :

Les "jobs à la con" de D. Graebber !

G. Giraud, Directeur de recherche au CNRS:

"3 milliards d'hommes

vont devoir migrer."-

Un tableau d'ensemble

du problème humain

P. Jorion, 11 oct 2019 -

Guillaume Pitron (01/2019)

"L'enfumage de la transition écologique" -

Bernard Tapie :

"1 job sur 3 supprimé dans 15 ans par l'IA" -

Thimotée Parrique :

"Notre compas d'organisation économique n'est plus à jour" -

François Jarrige :

"La technique doit être un outil d'accompagnement de nos décroissances matérielles" -

50% des jobs impactés d'ici 2040..(Scarpetta, ocde) -

Greta Thunberg,

"30 ans de bla bla, combien de

temps encore pour agir ?" -

14 juillet 2019

première rafle de pauvres ? -

1er dec 2018

tabassage ignoble et impuni de Mehdi K -

Filoche (02/2015) : "en Europe, le montant de la fraude fiscale est 2 x supérieur à celui de la dette" -

Whirlpool, ou l'apartheid social en marche -

"Mort aux cons",

le slogan qui succèdera à "juden raus ?" -

Mantes décembre 2018,

lycéens mis à genoux par la police -

Populimes, complotismes,

Notre cortex cingulaire

veut de la prédictibilité.

(S. Bolher, Psychiatre)

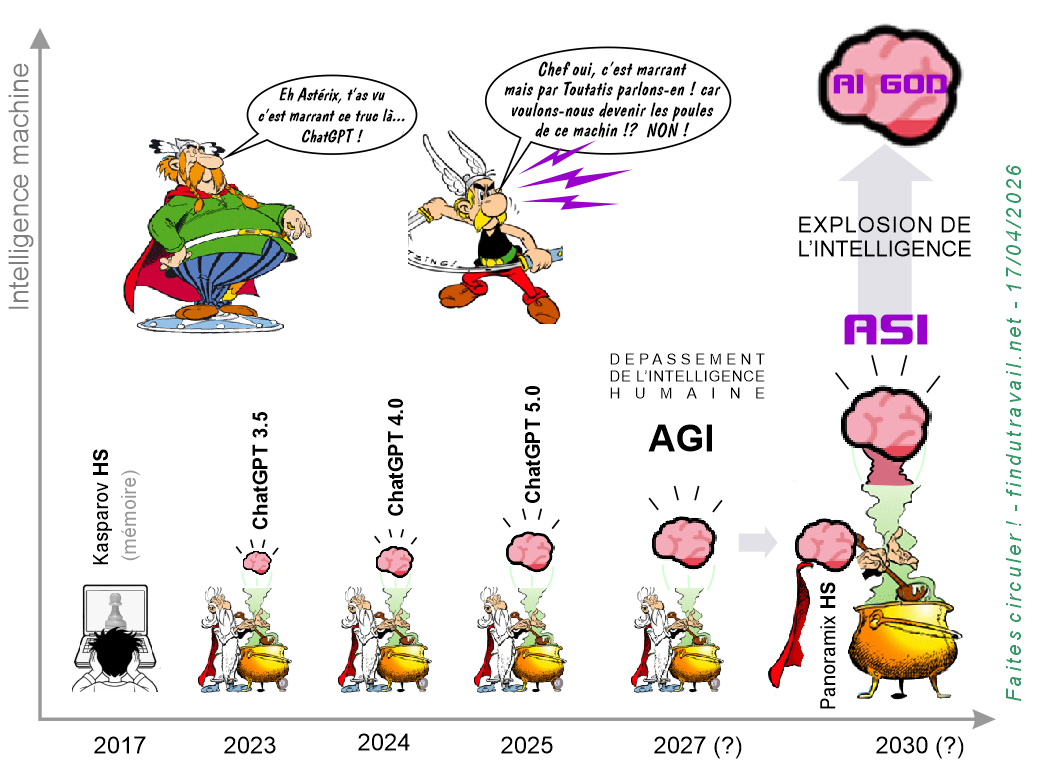

L'IA va nous rendre tous riches, et régler tous nos problèmes ? Mais alors pourquoi font-ils tous cette tête là ?

Tous inquiets ou presque. Sam Altman refusant de donner un chiffre de risque d'extinction

voir en grand dans un nouvel onglet.

On s'attendrait plutôt à les voir tous extrêmement détendus et joyeux, tous ces PDG d'OpenAI, de Grok, d'Anthropic, et tous ces chercheurs primés en IA ! Il ne se passe pas un jour sans qu'on voie la fin du monde dans leur yeux !

Pourquoi font-ils cette tête là ? C'est parce qu'ils pressentent que l'alignement de l'Intelligence artificielle sera impossible. Tous savent que l'IAG EST PROCHE et qu'elle sera DANGEREUSE, à cause de la faculté qu'elle aura de nous tromper en dissimulant ce qu'elle fait. Parmi ces personalités, ceux qui ont accepté de donner un risque d'extinction de l'humanité (0) le situent entre 10 et 99%. Au moins une chance sur 10 que toute l'humanité passe à la casserole !

C'est quoi au juste, cet ALIGNEMENT ? C'est le mot qui a été choisi pour désigner l'encadrement de l'IA, censé vérifier qu'elle reste "en ligne" avec les désirs et les craintes humaines, et qu'elle ne dérive pas vers quelquechose d'autre (1) qui menacerait la vie sur Terre. Une IAG bien alignée résoudrait le problème du changement climatique. Mal alignée,tout en poursuivant le même but, elle pourrait décider d'attaquer les actionnaires de Total, BP, Exxon.. avec des micro-drones !

Des micro-drones en forme de moustique instillant du poison, rien d'impossible pour la super intelligence...

Pourrions nous rivaliser contre une entité disposant d'un avantage techologique de plusieurs siècles ?

Mais une fois l'intelligence humaine dépassée (moment "AGI" d'ici quelques mois), ce ne seront plus des chercheurs humains qui pourront se charger de ce travail. Seule une autre AGI, plus puissante que celle que l'on souhaite contrôler, serait alors capable de s'en charger. Et donc on arrive à ce paradoxe insoluble, que pour sécuriser une IAG, disons ChatGPT 7.0 en 2027, il serait nécessaire de disposer en 2026 de ChatGPT 9.0 pour générer ces méthodes d'alignement !

Une analogie peut être faite avec le dopage au Tour de France. Pourquoi les mesures anti-dopages ont-elles toujours un temps de retard sur le dopage lui-même ? Pour doper efficacement un coureur, les sponsors mobilisent (moyennant finances, on imagine) la pointe de la recherche médicale. Ces chercheurs et ces moyens financiers, les agences anti-dopage ne les ont pas ! Je le mentionnais en 2017 dans cet article au sujet du Tour de France. Cependant, dans le cas du dopage, des solutions pourraient exister si les laboratoires renonçaient aux profits escomptés sur ces dernières recherches. Evidemment il ne l'entendent pas de cette oreille, pas plus que les sponsors, à qui le vainqueur fait gagner beaucoup d'argent !

Tout comme ces sponsors et ces laboratoires, ces firmes leaders en IA veulent être les meilleures en Intelligence Artificielle. Elles rivalisent pour rester à la pointe de la recherche, et offrir les meilleurs services. Et le danger est là, dans cette course à l'échalotte qui leur fait négliger le niveau de risque ! Ou bien elles minimisent ce problème de l'alignement(2), car le prendre en considération irait à l'encontre leurs intérêts. Il y a eu des précédents par le passé...citons l'amiante, qui offrait de tels perpsectives de profits qu'on a "volontiers oublié" sa toxicité pendant près de 80 ans(3)

L'humanité dopée par l'AGI pourrait bien s'apparenter à un coureur qui, grâce à la recherche et au dopage, gagne le Tour de France, mais qui meurt une semaine plus tard.

Tour de France 1967 - Paul Simpson meurt sur le Puy-de-Dôme, le dopage lui a fait dépasser ses limites physiologiques

L'IA : un nouvel être, sur le point de devenir un Dieu. Combien de temps nous reste-t-il ?

voir en grand dans un nouvel onglet.

(0) P(doom) = probabilité de conséquences catastrophiques

(1) quoi ? on ne peut pas l'imaginer

(2) comment ? en "espérant" un alignement naturel de l'AGI ! mais qui avant envie de jouer l'humanité à pile ou face ?

3) en 2012 au Canada, "l’Institut du chrysotile" minimisait encore les dangers de l'amiante, alors qu'ils étaient scientifiquement établis et publiés dans un rapport anglais dès 1930. L'institut était financé par les producteurs d'amiante du Canada, premier producteur mondial.

Vues :