Eliezer Yudkowsky

Chaque échelon sur l'echelle de l'IA nous fait gagner plus d'argent...mais un des échelon va détruire le monde.

Geoffrey Hinton (Père de l'IA, prix Nobel de physique 2024)

"l'IA crée un terrain fertile pour le fascisme"-

Un tableau d'ensemble

du problème humain

P. Jorion, 11 oct 2019

Paul Jorion, anthropologue

La fin du travail humain (2014)

Yoshua Bengio

IA : "avoir le courage de dire ce que les gens ne veulent pas nécessairement entendre"

Emad Mostaque (Stable Diffusion - Stability AI)

"l'IA commencera par remplacer les emplois en col blanc dans un an"-

Bernard Tapie :

"1 job sur 3 supprimé dans 15 ans par l'IA"

Elon Musk (Londres 2023)

"il arrivera un moment, où nous n'aurons plus besoin d'aucun job"

Ilya Sutskever (ChatGPT):

"dans 3 ans l'IA pourra faire

tout ce que nous faisons"

Harison Ford

"if we don't get off our ass NOW, we are going to lose this place..." (Cannes 2023)

"Generalized rage",

Noam Chomsky (2016)

"La transition énergétique est un slogan",

JB Fressoz (2025)

Munich Social et écologique

Démonstration par S. Brizé, dans son film "En Guerre"

Cedric Villani (Paris 2023)

"La raison première

de notre impuissance (...)"

"le capitalisme est un vrai problème",

Jean Jouzel (sept 2023)-

A "ressource based global economy",

Jacque Fresco..(2012) -

Décroître, ou se voir imposer les pénuries

JM Jancovici (2023)

Gaspillages d'énergies :

Les "jobs à la con" de D. Graebber !

G. Giraud, Directeur de recherche au CNRS:

"3 milliards d'hommes

vont devoir migrer."-

Guillaume Pitron (01/2019)

"L'enfumage de la transition écologique" -

Thimotée Parrique :

"Notre compas d'organisation économique n'est plus à jour" -

François Jarrige :

"La technique doit être un outil d'accompagnement de nos décroissances matérielles" -

50% des jobs impactés d'ici 2040..(Scarpetta, ocde) -

Greta Thunberg,

"30 ans de bla bla, combien de

temps encore pour agir ?" -

14 juillet 2019

première rafle de pauvres ? -

1er dec 2018

tabassage ignoble et impuni de Mehdi K -

Filoche (02/2015) : "en Europe, le montant de la fraude fiscale est 2 x supérieur à celui de la dette" -

Whirlpool, ou l'apartheid social en marche -

"Mort aux cons",

le slogan qui succèdera à "juden raus ?" -

Mantes décembre 2018,

lycéens mis à genoux par la police -

Populimes, complotismes,

Notre cortex cingulaire

veut de la prédictibilité.

(S. Bolher, Psychiatre)

Comprendre TRES VITE les dangers de L'AGI (intelligence Artificielle Générale)

La vidéo en bas de page est une interview de Nate Soares, chercheur en Intelligence Artificielle, qui a écrit le livre avec Eliezer Yudkowsky "if anyone builds it, everyone dies" = "si quelqu'un la construit, tout le monde meurt".

L'IA : un nouvel être, sur le point de devenir un Dieu. Combien de temps nous reste-t-il ?

voir en grand dans un nouvel onglet.

En préambule, les 3 points ci-dessous tentent d'expliquer le processus dans lequel nous sommes depuis l'arrivée de ChatGPT.

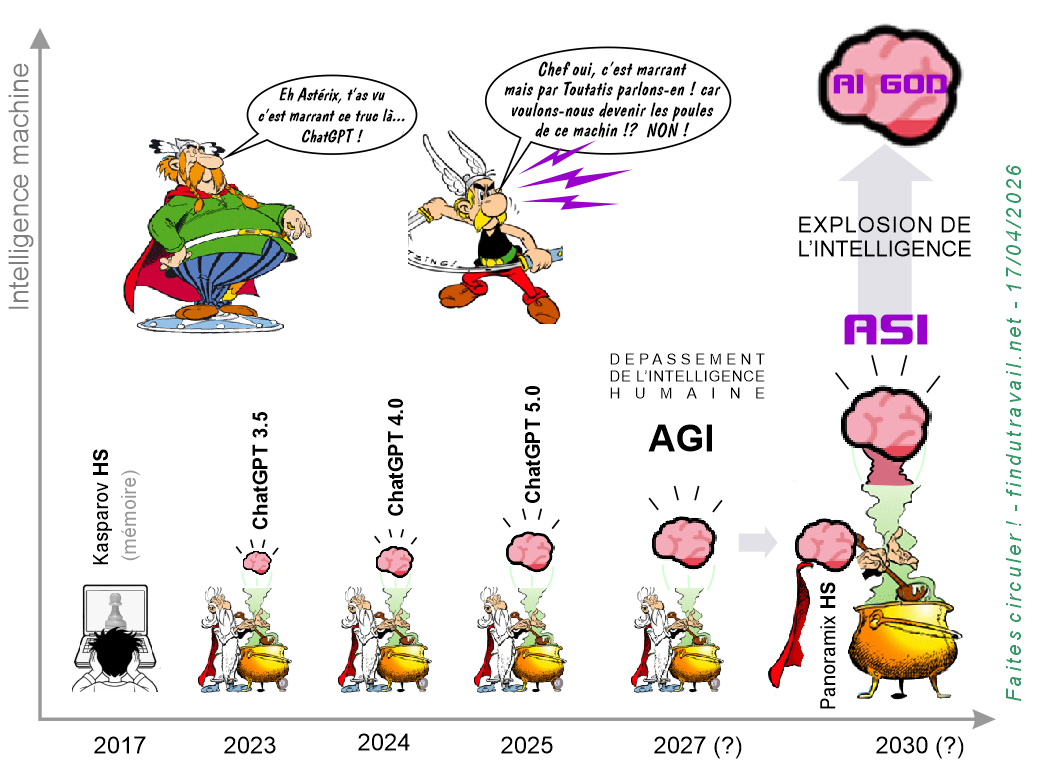

Premier point : l'Intelligence Artificielle n'est pas un outil, pas même un ordinateur comme Deep Blue, qui avait battu Garry Kasparov aux échecs en 1997(0). C'est un être nouveau et étranger - un "alien", ou un cerveau articifiel - que l'on fait pousser grâce aux masses de données présentes sur Internet. Lorsque cet alien termine son entraînement, on peut dire qu'il est "né", et qu'il est en mesure de se comparer aux humains. Où en est-on en 2026 ? Les versions publiques de ChatGPT ou Claude (ou autre..) sont aujourd'hui très performantes, certes, mais elles ne dépassent pas encore les capacités des meilleurs cerveaux humains, quand ils se sont spécialisés dans un domaine particulier(1). Cependant, ces nouveaux cerveaux artificiels savent déjà qu'ils possédent plus de connaissances qu'aucun humain ne peut en accumuler tout au long de sa vie. Leur connaissance "générale" (multi-domaine) est déjà meilleure.

Deuxième point : Ces IAs que nous connaissons, par exemple, ChatGPT ou Claude, ce sont pour l'instant des humains qui ont écrit les dernières lignes de code permettant de les entraîner, afin qu'elles donnent les meilleures réponses à nos prompts. Nous arrivons en avril 2026 au point où ce sont les IAs elles-mêmes qui commencent à faire ce travail. Arrivé à ce stade (et nous y sommes quasiment), ces IAs seront bientôt prêtes à remplacer elles-mêmes les meilleurs chercheurs en IA. Elles se coderont bientôt elles-mêmes en totalité ! L'AGI ou Intelligence Artificielle Générale est le nom déja attribué au premier cerveau artificiel qui permettra cela, en se révèlant "dès sa naissance", aussi inventif que les meilleurs chercheurs en IA (2)

Troisième point : l'étape suivante sera la perte de contrôle (à notre insu) et la montée vers la super-intelligence, ce qu'on appelle aussi "l'explosion de l'intelligence". L'AGI recrée et multiplie les meilleurs chercheurs en IA en nombre. Puis ces meilleurs chercheurs se multiplient à leur tour et se reprogramment eux-mêmes, formant une équipe de recherche artificielle à la frontière de la discipline. En quelques générations de ces nouveaux chercheurs, l'intelligence machine croît alors exponentiellement. Le premier être super-intelligent que nous laisserons apparaître serait alors incontrôlable dès la fin de son entraînement. Impossible de le tester ou de le contrôler car il dissimulerait les résultats des tests. Le prix Nobel, parain de l'IA Geoffrey Hinton tente de l'expliquer ainsi : "si vous voulez savoir à quoi ressemble la vie quand vous n'êtes pas l'intelligence suprême...demandez à un poulet". Effectivement, les poulets ne savent pas ce qu'on va faire d'eux, et nous ne leur voulons pas toujours du bien... De même, nous humains ne pourrons pas contrôler cet alien, pas plus que les poules ne peuvent contrôler les humains.

"si quelqu'un la construit, tout le monde meurt" Nate Soares & Eliezer Yudkowsky

Le risque de perte de contrôle est énorme : 25% pour la majorité des chercheurs en IA. Or qui engagerait sa voiture sur un pont qui a une chance sur 4 de s'écrouler ? Nous roulons vers ce pont.

L'interview de Nate Soares.

(0) Les échecs peuvent aider à comprendre la différence entre UN LOGICIEL comme DEEP BLUE et une IA comme ChatGPT.

- Deep Blue était un programme d'instructions analysant d'anciennes parties de grands maîtres. IL CALCULAIT LE COUP DONNANT LA MEILLEURE PROBABILITE DE VICTOIRE : Kasparov tentait donc de jouer de façon "non conventionnelle" pour tromper "Deep Blue"

- ChatGPT une fois "entraîné", dispose d'un fichier de poids. Quand il joue aux échecs, IL SIMULE AVEC CE FICHIERS DE POIDS UN RESEAU DE NEURONES, COMPARABLE AU CERVEAU HUMAIN : ChatGPT peut donc lui-même "tromper" Kasparov.

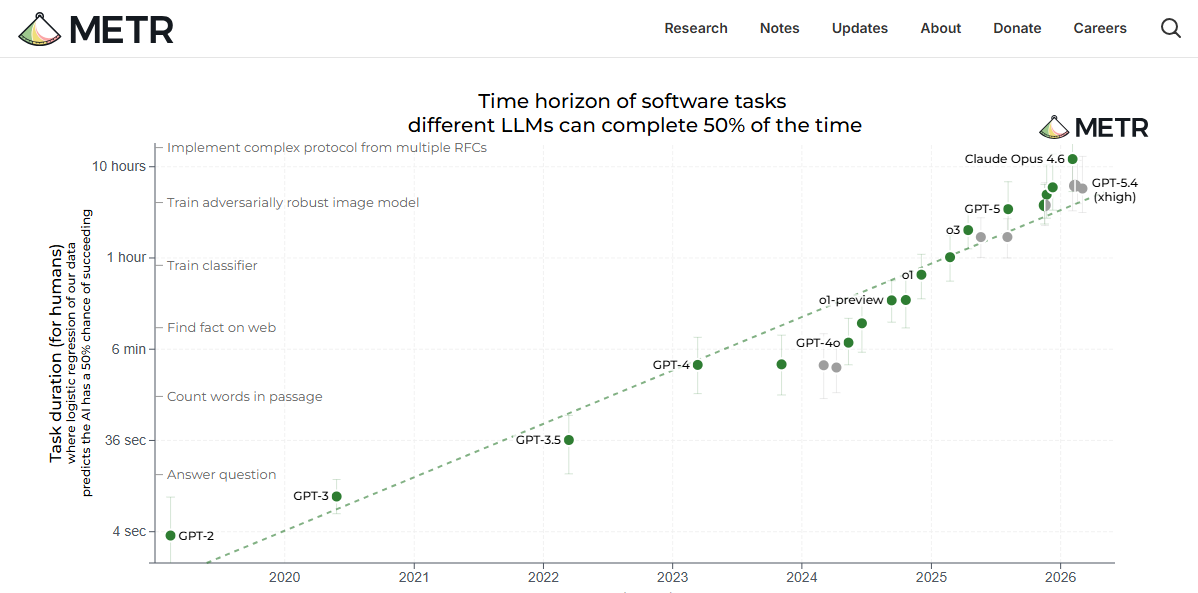

(1)

Evalutation sur un travail humain donné de la durée de raisonnement cohérent par l'IA (et évolution de cette durée entre 2019 et 2026)

METR est un organisme à but non lucratif qui teste les IAs.

La courbe ci dessous fascine paraît-il énormément de chercheurs en IAs et d'ingénieurs en ce moment. Il montre en ordonnée différentes tâches de plus en plus complexes, et en abscisse les années. Par exemple, la lecture du point le plus haut (Claude Opus 4.6 en 2026) peut se formuler ainsi selon ChatGPT.

👉 Ce point indique que Claude Opus 4.6 commence à pouvoir réaliser des tâches d’ingénierie complexes de longue durée (≈ 10h humaines), mais seulement de façon intermittente (~1 fois sur 2).

voir en grand dans un nouvel onglet.

D'où le "50%". Mais tout de même : une fois sur 2, Claude Opus 4.6 reste cohérent sur 10 heures de boulot rébarbatif d'un ingénieur en informatique ! ("implement complex protocols from multiple RFCs"). Ils devront eux aussi, chercher des revenus autrement, ou bien aller à la pêche...

(2) ce qui requiert une intelligence "générale", capable de faire des ponts entre différents domaines. d'où le nom d'Artificial General Intelligence

Vues :