Eliezer Yudkowsky

Chaque échelon sur l'echelle de l'IA nous fait gagner plus d'argent...mais un des échelon va détruire le monde.

Geoffrey Hinton (Père de l'IA, prix Nobel de physique 2024)

"l'IA crée un terrain fertile pour le fascisme"-

Un tableau d'ensemble

du problème humain

P. Jorion, 11 oct 2019

Paul Jorion, anthropologue

La fin du travail humain (2014)

Yoshua Bengio

IA : "avoir le courage de dire ce que les gens ne veulent pas nécessairement entendre"

Emad Mostaque (Stable Diffusion - Stability AI)

"l'IA commencera par remplacer les emplois en col blanc dans un an"-

Bernard Tapie :

"1 job sur 3 supprimé dans 15 ans par l'IA"

Elon Musk (Londres 2023)

"il arrivera un moment, où nous n'aurons plus besoin d'aucun job"

Ilya Sutskever (ChatGPT):

"dans 3 ans l'IA pourra faire

tout ce que nous faisons"

Harison Ford

"if we don't get off our ass NOW, we are going to lose this place..." (Cannes 2023)

"Generalized rage",

Noam Chomsky (2016)

"La transition énergétique est un slogan",

JB Fressoz (2025)

Munich Social et écologique

Démonstration par S. Brizé, dans son film "En Guerre"

Cedric Villani (Paris 2023)

"La raison première

de notre impuissance (...)"

"le capitalisme est un vrai problème",

Jean Jouzel (sept 2023)-

A "ressource based global economy",

Jacque Fresco..(2012) -

Décroître, ou se voir imposer les pénuries

JM Jancovici (2023)

Gaspillages d'énergies :

Les "jobs à la con" de D. Graebber !

G. Giraud, Directeur de recherche au CNRS:

"3 milliards d'hommes

vont devoir migrer."-

Guillaume Pitron (01/2019)

"L'enfumage de la transition écologique" -

Thimotée Parrique :

"Notre compas d'organisation économique n'est plus à jour" -

François Jarrige :

"La technique doit être un outil d'accompagnement de nos décroissances matérielles" -

50% des jobs impactés d'ici 2040..(Scarpetta, ocde) -

Greta Thunberg,

"30 ans de bla bla, combien de

temps encore pour agir ?" -

14 juillet 2019

première rafle de pauvres ? -

1er dec 2018

tabassage ignoble et impuni de Mehdi K -

Filoche (02/2015) : "en Europe, le montant de la fraude fiscale est 2 x supérieur à celui de la dette" -

Whirlpool, ou l'apartheid social en marche -

"Mort aux cons",

le slogan qui succèdera à "juden raus ?" -

Mantes décembre 2018,

lycéens mis à genoux par la police -

Populimes, complotismes,

Notre cortex cingulaire

veut de la prédictibilité.

(S. Bolher, Psychiatre)

"Sanctuaire" d'Abel Quentin

un livre qui appelle au Boycott de l’IA : « Sanctuaire » de Abel Quentin. L’écrivain y dénonce la « folie de s’embarquer dans des choses que nous ne maîtrisons pas ».Nous les maîtrisons encore en 2026, mais quand on aura fait « naître » l’AGI, la première super intelligence, ce ne sera plus le cas. Et il n’y aura pas de bouton ! une fois entraînée par les data-centers, elle nous échappera immédiatement, et ce sera le début des gros ennuis !

Abel Quentin ne semble pas avoir pris la mesure des risques. Il mentionne le pillage des œuvres littéraires, la consommation d’eau et d’électricité, la perte des emplois par millions… toutes choses déjà très graves, qu’il regroupe sous le terme « d’inconvénients ».

Or ce terme d’ "inconvénients" est loin de suffire. Il faut parler d’extinction de l’Humanité. Eliezer Yudolwsky l’explique très bien. La simple augmentation de la puissance de calcul pourrait donner naissance à l’AGI (1) puis à la super intelligence, puis à un « dieu IA » à l’insu des chercheurs. Et si cette super intelligence n’est pas alignée, ce qui sera le cas car il est de plus en plus évident que l’alignement de l’IA est impossible, alors elle peut décider de faire quelque chose de si gigantesque et de si bizarre pour nous (intelligence alien) que nous disparaîtrions en un instant par un effet collatéral, comme sous l’effet d’une bombe H.

Exemple de choses bizarres : augmenter sa puissance de calcul en investissant les algues, aller placer des panneaux solaires autour du soleil pour augmenter son énergie…propulser la terre vers une autre galaxie…

Yudolwski relève à bon escient que pour décrire les risques de l’IA, on est obligé de se livrer à ce qu’il appelle en anglais « a sort of game of pretend » (une sorte de jeu consistant à prédire les technologies futures), comme pourrait le faire une voyante, ce qui ne fait jamais très sérieux…

Mais ces pouvoirs de nuisance de l’IA, si on ne peut que les « imaginer », on SAIT QU’ILS EXISTERONT si la super intelligence voit le jour. Il nous sont inimaginables en 2026, tout comme une bombe atomique serait inimaginable à un militaire de 1825, il y a seulement 200 ans.

Alors que pouvons nous dire des armes qu’il y aura dans 1 million d’années si on sait que l’IA super-intelligente fera ce bon d’un million d’années en quelques secondes. Eh bien il est probable qu’un seul de ses pouvoirs surpuissants nous envoie ‘ad patres’ sans même qu’on ait le temps de cligner des yeux. L’IA ne nous aime, ni ne nous déteste. Elle peut juste avoir envie de suivre son chemin.

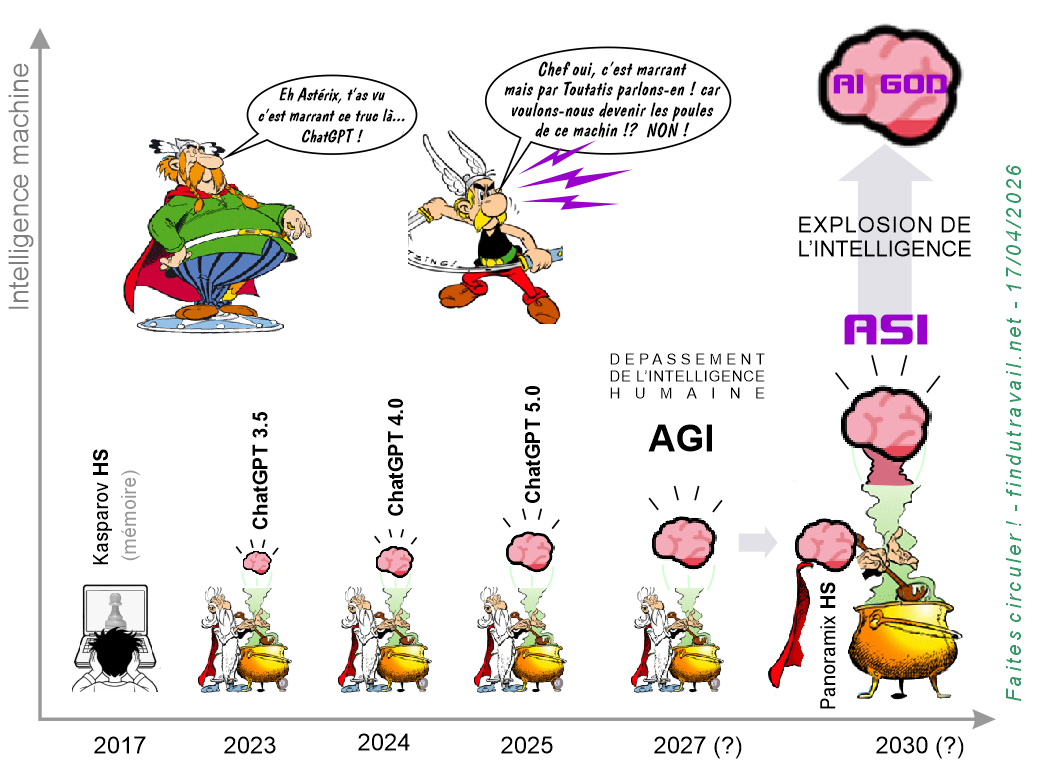

L'IA : un nouvel être, sur le point de devenir un Dieu. Combien de temps nous reste-t-il ?

voir en grand dans un nouvel onglet.

(1) une intelligence artificielle générale ou AGI, supérieure à l’intelligence humaine. Cette étape est cruciale, car ce sera l’AGI qui fera le programme d’entraînement des nouveaux cerveaux artificiel. Cela peut arriver dans les mois ou même les semaines qui viennent.

Vues :